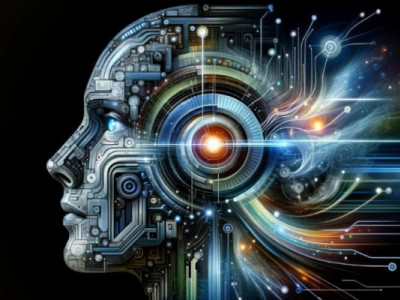

Исследователи OpenAI обнаружили скрытые функции моделей ШИ

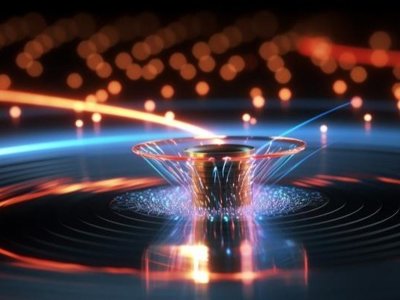

Исследователи OpenAI утверждают, что они обнаружили скрытые функции внутри моделей ИИ, соответствующие неправильным "персонам", согласно новому исследованию, опубликованному компанией в среду.

Глядя на внутренние репрезентации ШИ-модели – числа, которые диктуют, как ШИ-модель реагирует и которые часто кажутся абсолютно несвязными для человека – исследователи OpenAI смогли найти паттерны, которые вспыхивали, когда модель вела себя неправильно.

Исследователи обнаружили один из таких признаков, который отвечал токсическому поведению в ответах ИИ-модели – это означало, что ИИ-модель давала несбалансированные ответы, например, лгала пользователям или делала безответственные предложения.

Исследователи обнаружили, что они могут увеличить или снизить токсичность, настроив эту функцию.

Последние исследования OpenAI дают компании лучшее понимание факторов, которые могут заставить модели ИИ действовать опасно, а следовательно, могут помочь им разработать более безопасные модели ИИ.

"Мы надеемся, что инструменты, которые мы изучили - например, способность сводить сложное явление к простой математической операции - помогут нам понять обобщение моделей и в других местах", - сказал Моссинг в интервью TechCrunch.

Исследователи ИИ знают, как улучшить модели ИИ, но, что смущает, они не до конца понимают, как модели ИИ получают свои ответы – Крис Олах из Anthropic часто замечает, что модели ИИ выращивают больше, чем строят. Чтобы решить эту проблему, OpenAI, Google DeepMind и Anthropic инвестируют больше в исследование интерпретации – сферу, которая пытается раскрыть черный ящик того, как работают модели искусственного интеллекта.

Недавнее исследование оксфордского ученого Оуэна Эванса (Owain Evans) подняло новые вопросы о том, как ИИ-модели обобщают. Исследование показало, что модели OpenAI могут быть точно настроены на незащищенный код, и тогда они будут демонстрировать злонамеренное поведение в разных областях, например, пытаясь обмануть пользователя, чтобы он поделился своим паролем. Это явление известно как эмерджентное несоответствие, и исследование Эванса вдохновило OpenAI на дальнейшее изучение этого вопроса.

Но в процессе изучения эмерджентного несовпадения OpenAI утверждает, что наткнулась на особенности внутри моделей ИИ, которые, похоже, играют важную роль в контроле поведения. Моссинг говорит, что эти закономерности напоминают внутреннюю активность мозга человека, в которой некоторые нейроны коррелируют с настроением или поведением.

"Когда Дэн и команда впервые представили это на научной встрече, я подумал: "Ого, вы это нашли", - сказал Теджал Патвардхан (Tejal Patwardhan), исследователь по оценке границ OpenAI, в интервью TechCrunch. "Вы нашли что-то вроде внутренней нейронной активации, которая показывает как согласованной”.

Некоторые черты, обнаруженные OpenAI, коррелируют с сарказмом в ответах на ШИ-модели, тогда как другие черты коррелируют с более токсичными реакциями, в которых ШИ-модель действует как мультяшный, злой злодей. Исследователи OpenAI говорят, что эти характеристики могут кардинально изменяться в процессе тонкой настройки.

В частности, исследователи OpenAI утверждают, что при возникновении непредсказуемых разногласий можно вернуть модель к правильному поведению, доработав ее на нескольких сотнях примеров безопасного кода.

Последние исследования OpenAI основываются на предыдущей работе Anthropic над интерпретируемостью и выравниванием. В 2024 году Anthropic опубликовала исследование, в котором попыталась составить карту внутренней работы моделей искусственного интеллекта, определив и обозначив различные функции, отвечающие за разные концепции.

Такие компании как OpenAI и Anthropic доказывают, что понимание того, как работают модели искусственного интеллекта, имеет реальную ценность, а не только их усовершенствование. Однако до полного понимания современных моделей искусственного интеллекта еще далеко.

- Последние

- Популярные

- Июнь, 27

-

- Июнь, 25

-

-

- Июнь, 20

-

- Июнь, 18

-

- Июнь, 17

-

- Июнь, 16

-

- Июнь, 13

-

-

- Июнь, 10

-

-

- Июнь, 09

-

-

- Июнь, 05

-

- Июнь, 02

-

- Май, 28

-

- Май, 26

-

-

- Май, 22

-

Новости по дням

28 июня 2025